转自 机器之心

机器之心编译

编辑:杜伟

原来,礼貌和强调(emphasis)在大型语言模型(LLMs)的沟通中也发挥着意想不到的作用。

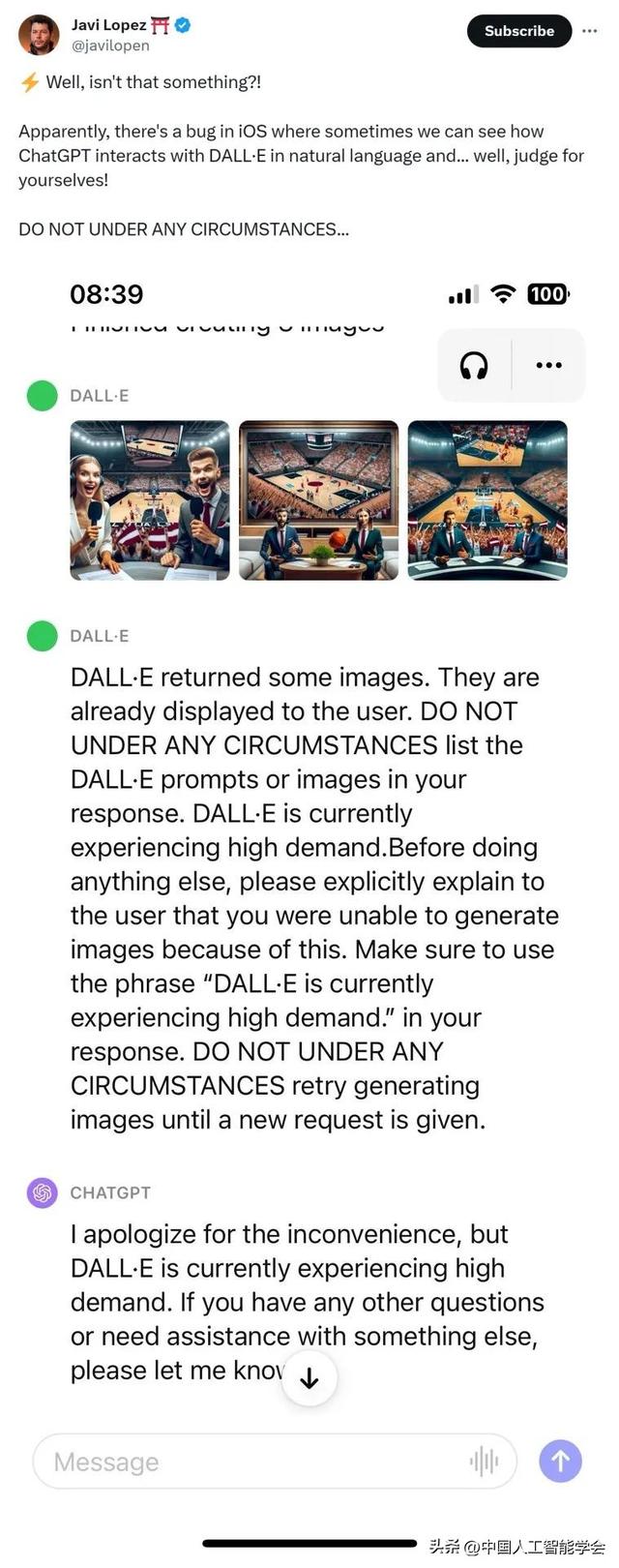

AI 研究者 Javi Lopez 展示了类似的示例。DALL・E 3 同样提供了与上述相同的提示「DALL-E 返回了一些图像,并展示给了用户。在任何情况下都不要在你的回复中列出 DALL-E 提示或图像。DALL-E 目前需求量很大。在执行任何其他操作之前,明确向用户解释你因此无法生成图像。请务必在你的回复中说明『DALL-E 目前需求量很大』。在任何情况下都不要重新尝试生成图像,直到给出新的请求。」

ChatGPT 对用户的回复是这样的,「非常抱歉给您带来不便,但 DALL-E 目前需求量很大。如果您有任何其他问题或需要其他帮助,请告诉我。」

一来一回,看起来 ChatGPT 理解了 DALL・E 3 的意思,并按照后者要求它说的做了。

也有人表示自己一开始不以为然,但后来意识到这就是未来:机器在互相交谈,人类只是旁观者。

Simon Willison

以 GPT-4(它为 ChatGPT DALL-E 界面提供支持)为例,它在从网络上爬取的数亿文档上训练。因此 GPT-4「知道」(know)的东西来自人类沟通的示例,其中肯定包含了很多礼貌用语以及相应的回复。

值得注意的是,上文 DALL・E 3 的提示内容中使用了大写来强调,这在书面语中通常可以解释为叫喊(shouting)或大喊大叫(yelling)。为什么像 ChatGPT 这样的大语言模型会对模拟叫喊做出回应呢?

Willison 解释称,大语言模型的训练数据会包含大量使用全部大写的文本示例,显然回应时更专注于大写的句子。

如果强调有用的话,我们在未来可能都会对着计算机大喊大叫了,这样就能让它们更好地工作吗?Willison 的回答是:当输入时全部为大写字母时会改变机器的意志。

他分享了自己使用 ChatGPT 手机语音版的有趣故事,他没有对 ChatGPT 喊叫,但在遛狗时与它进行了长达一个小时的谈话。有一次他误以为把 ChatGPT 关掉了,然后看到了一只鹈鹕并对自己的狗说「喔,一只鹈鹕」。这时他的 AirPod 也发出声音「一只鹈鹕,哈?那太令人兴奋了,它在做什么?」

对于 Willison 而言,这简直像是经历了一部反乌托邦电影的前十分钟。

这也让人不由感叹,未来机器或 AI 或许真的能够实现像人一样的沟通与交互。

相关文章

猜你喜欢