最近几天,科技圈最关注的就是OPEN AI内斗大戏,其实国内的吃瓜群众可能看多了宫斗剧,所以把当下的OPEN AI发生的人事变动也当作精彩的公司权利内斗戏来调侃。

那么,你们的格局都太小了。

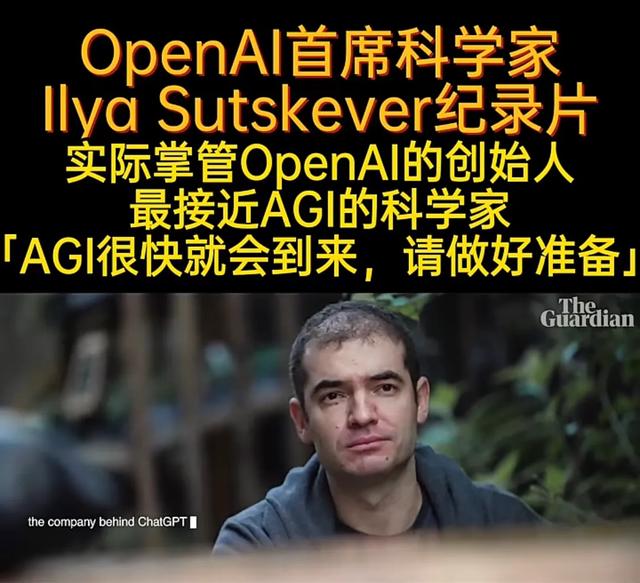

OPEN AI的两个灵魂人物,CEO奥特曼和首席科学家IlYA都不是普通人的格局,一个是要用技术改变世界,一个是要深度思考人类的未来在哪里,技术层面和哲学层面发生冲突和矛盾时,谁对谁错真的很难评。

一直以来,OPENAI 内部有两派意见:一派是Ilya和Mira,认为必须慢下来优先解决AI安全的问题。一派则是Sam和Greg,希望通过Gpts、GPT store等方式,快速建立生态,扩大商业优势。

而CHAT GPT4.0已经基本上接近AGI。这里科普一下,AGI是Artificial General Intelligence的缩写,中文应该是“通用人工智能”,是指一种能够像人类一样思考、学习和执行多种任务的人工智能系统。"AGI"这个词汇最早可以追溯到2003年由瑞典哲学家Nick Bostrom发表的一篇论文《Ethical Issues in Advanced Artificial Intelligence》。在该论文中,Bostrom讨论了超级智能的道德问题,并在其中引入了"AGI"这一概念,描述了一种能够像人类一样思考、学习和执行多种任务的人工智能系统的概念。

可以说AGI一旦出现,比人类智慧高出的不是一点半点,所以在一定程度上就存在反噬人类的危险。

所以OPEN AI内部两派之争就是不同的信仰分歧带来的:Sam认为技术要无限加速,越快越好;Ilya认为AGI不是普通的技术,可能反噬人类,要确认好安全的进化起点,恐怕只能二选一。

这让我突然想到了美国科幻电影《终结者》,电影里人类不就是被自己创造的人机智能机器人而统治和毁灭掉。所以难怪霍金说“彻底开发人工智能可能导致人类灭亡”。

所以,作为人类一员,我支持IIYA的观点和他所代表的OPENAI董事会的决定。

相关文章

猜你喜欢